Serviços Personalizados

Journal

Artigo

Indicadores

-

Citado por SciELO

Citado por SciELO -

Acessos

Acessos

Links relacionados

-

Similares em

SciELO

Similares em

SciELO

Compartilhar

Sociologia, Problemas e Práticas

versão impressa ISSN 0873-6529

Sociologia, Problemas e Práticas no.86 Lisboa mar. 2018

https://doi.org/10.7458/SPP20188610056

ARTIGO ORIGINAL

Avaliação do desempenho da investigação aplicada no ensino superior politécnico: construção de um modelo

Performance assessment of applied research in polytechnics: construction of a model

Évaluation de la performance de la recherche appliquée à lenseignement supérieur polytechnique: construction dun modèle

Evaluación del desempeño de la investigación aplicada en la enseñanza superior politécnica: construcción de un modelo

Maria Teresa Patrício*, João Emílio Alves**, Elisa Alves***, Joaquim Mourato****, Patrícia Santos***** e Rui Pulido Valente******

* Professora associada no Instituto Universitário de Lisboa (ISCTE-IUL). Investigadora do Centro de Investigação e Estudos de Sociologia (CIES-IUL), Lisboa, Portugal. E-mail: teresa.patricio@iscte-iul.pt

** Professor adjunto no Instituto Politécnico de Portalegre e investigador no Centro de Investigação e Estudos de Sociologia (CIES-IUL), Lisboa, Portugal. E-mail: j.alves@ipportalegre.pt

*** Investigadora no Centro de Investigação e Estudos de Sociologia (CIES-IUL), Lisboa, Portugal. E-mail: elisa.palma.alves@gmail.com

**** Professor coordenador no Instituto Politécnico de Portalegre, Portalegre, Portugal. E-mail: amourato@ipportalegre.pt

***** Investigadora no Centro de Investigação e Estudos de Sociologia (CIES-IUL), Lisboa, Portugal. E-mail: ana.patricia.santos@iscte-iul.pt

****** Professor adjunto no Instituto Politécnico de Portalegre, Portalegre, Portugal. E-mail: rpval@estgp.pt

RESUMO

Apresenta-se um modelo de avaliação de desempenho da investigação aplicada nas instituições de ensino superior politécnico (IESP) em Portugal, centrado na construção de indicadores quantitativos e qualitativos, na missão destas instituições, bem como no impacto regional decorrente da sua ação. O modelo, apurado a partir de três estudos de caso, organiza-se em três dimensões: inputs, outputs e impactos da investigação aplicada. Inova por representar uma perspetiva holística da avaliação da produção académica, em particular das IESP. A inexistência de modelos de avaliação deste tipo no ensino superior português coloca, porém, desafios ao seu desenho, à recolha de informação e ao próprio modo de funcionamento das IESP (financiamento, organização, etc.).

Palavras-chave: instituições de ensino superior politécnico, indicadores de desempenho, investigação aplicada.

ABSTRACT

A model is presented to evaluate the performance of polytechnic institutions of higher education (PIHE) in Portugal with regard to applied research. The model, obtained from three case studies, is based on the construction of quantitative and qualitative indicators, the mission of these institutions, and the regional impact of their activities. It is organized according to three dimensions: inputs, outputs and impacts of applied research. This approach represents an innovative holistic perspective to evaluate the academic production of polytechnics. The inexistence of models of evaluation for this type of Portuguese higher education institutions raises challenges in terms of design, data collection and mode of functioning of the PIHE (financing, organization, etc.).

Keywords: polytechnic institutions of higher education, performance indicators, applied research.

RÉSUMÉ

Nous présentons ici un modèle pour évaluer la performance des institutions polytechniques denseignement supérieur (IPES) du Portugal en matière de recherche appliquée. Développé grâce à trois études de cas, ce modèle est construit à partir dindicateurs quantitatifs et qualitatifs, de la mission de ces institutions et de limpact régional de leurs activités. Il est organisé suivant trois dimensions : inputs, outputs et impacts de la recherche appliquée. Cette approche représente une perspective holistique innovatrice pour évaluer la production académique des IPES. Linexistence de tels modèles dévaluation soulève des défis pour leur conception, la collection de données et le mode de fonctionnement des IPES (financement, organisation, etc.).

Mots-clés: institutions polytechniques denseignement supérieur, indicateurs de performance, recherche appliquée.

RESUMEN

Se presenta un modelo para evaluar el desempeño de las instituciones politécnicas de educación superior (IPES) en Portugal en relación con la investigación aplicada. El modelo se ha obtenido a partir de tres estudios de caso. Se basa en la construcción de indicadores cuantitativos y cualitativos, la misión de estas instituciones, y el impacto regional de sus actividades. Se organiza en función de tres dimensiones: contribuciones, resultados e impactos de la investigación aplicada. Este enfoque representa una perspectiva holística innovadora para evaluar la producción académica de las IPES. La inexistencia de modelos de evaluación para este tipo de instituciones y niveles de educación plantea desafíos en términos de diseño, recogida de datos y el modo de funcionamiento de las IPES (financiación, organizaciones, etc.).

Palabras-clave: instituciones politécnicas de educación superior, indicadores de desempeño, investigación aplicada.

Introdução

A contribuição das instituições de ensino superior politécnico (IESP) para o desenvolvimento regional, incluindo a formação e qualificação da população ativa, constitui atualmente uma ideia amplamente aceite (OECD, 2007). A importância da região tem vindo a ser reforçada com a crescente promoção das relações entre a produção do conhecimento e a economia. A estratégia de desenvolvimento regional assenta em identificar vantagens comparativas, promover políticas públicas e articular o ensino superior, a indústria e a sociedade.[1]

Os desafios múltiplos têm levado as IESP a expandir as suas missões tradicionais, indo ao encontro de uma investigação aplicada em estreita ligação ao tecido social e económico regional, objetivo previsto aquando da sua criação (Almeida, 2008). Estas missões transformam-nas num motor importante para o desenvolvimento regional a partir de uma ampla gama de atividades para além dos limites da comunidade académica, em colaboração com empresas, autoridades públicas e outros atores locais (Lockett e Wright, 2005). No entanto, alguns estudos têm evidenciado que, tanto em Portugal como na Europa, os benefícios decorrentes dessas relações ainda estão longe do seu verdadeiro potencial, mesmo quando o tipo de investigação mais representado nestas instituições é a investigação aplicada (63% do total da investigação realizada no contexto europeu Weert e Soo, 2009). Em Portugal, o principal desafio relaciona-se com o compromisso a todos os níveis com as atividades de produção, transferência e valorização económica do conhecimento (Dias, 2012) e um contexto de debilidade em termos de unidades de investigação e desenvolvimento (I&D) existentes, projetos de investigação financiados, despesa em I&D e recursos humanos envolvidos (Comissão de Educação e Ciência da Assembleia da República, 2010).

A identificação de indicadores para quantificar o contributo das instituições de ensino superior nesta terceira missão tem sido referida como a tarefa invisível de universidades e politécnicos (Goddard et al., 2003). As métricas existentes são fonte recorrente de debate, longe de convergir numa fórmula única e aceite pela comunidade. As principais críticas vêm da incapacidade de distinguir os fatores ambientais e, na maioria dos casos, tratar-se de modelos combinados das diferentes missões, que pouco traduzem as atividades (Liu e Cheng, 2005). A situação é ainda mais complexa quando da revisão bibliográfica sobressai a escassez de estudos acerca da realidade das IESP (Urbano, 2011) e, sobretudo, de estudos sobre o papel da investigação ou o contributo para o desenvolvimento regional neste tipo de instituições. Diferenças em termos de áreas disciplinares e científicas geram ainda mais complexidade (Vorley e Nelles, 2008; Whitchurch, 2008) e esta é também evidente quando se tenta desenvolver métricas que integram todas as atividades inerentes a estes âmbitos de ação (Cave et al., 2006 [1996]; Molas-Gollart, 2002).

O presente texto tem origem num projeto intitulado A Cultura do Desempenho. A Produção, Transferência, Difusão e Outros Impactos do Conhecimento do Ensino Superior Politécnico,[2] tendo como principal objetivo identificar indicadores de desempenho nas IESP no que se refere às atividades de investigação aplicada e ao seu impacto nas regiões em que estão inseridas. Como fio condutor da investigação partiu-se da discussão de três princípios orientadores que direcionaram o trabalho: (1) as ambiguidades e potencialidades do conceito de investigação aplicada; (2) a utilização de indicadores quantitativos nos processos de avaliação qualitativos, incluindo considerações sobre as diferenças entre áreas científicas; e (3) o contexto e as capacidades das IESP no sistema de ensino superior em Portugal.

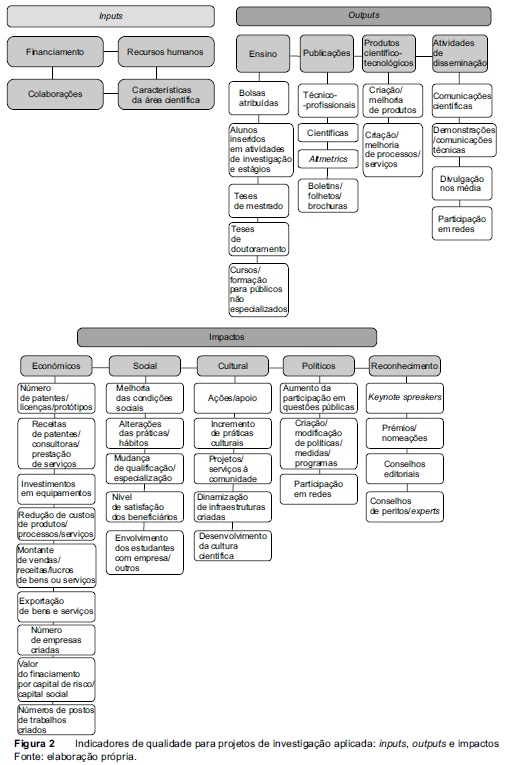

Os processos de avaliação convencionalmente utilizam modelos que variam entre input-processo-output, input-output-outcome-impacto ou input-output-impacto, onde medições e ponderações do processo de produção do conhecimento proliferam (European Commission, 2009). O modelo desenhado assentou no input-output-impacto da produção científica, com recurso a metodologias quantitativas e qualitativas através da identificação de casos de sucesso de investigação aplicada em diferentes IESP. Selecionaram-se 12 projetos de investigação aplicada em três IESP que representam instituições de diferentes dimensões e em contextos regionais distintos. Os projetos foram escolhidos por, genericamente, representarem casos bem-sucedidos de impacto regional significativo, a partir de uma seleção realizada pelos representantes das instituições envolvidas no estudo e de acordo com indicações definidas pela equipa do projeto.

Os resultados foram organizados em termos de outputs académicos e de impactos sociais, económicos, políticos, culturais e simbólicos, os quais são reunidos numa matriz da qual daremos conta no final do texto.

A investigação aplicada como ponto de partida

Desde 1963 a OCDE, através do Manual Frascati, serve de referência na definição de investigação e desenvolvimento (I&D) (OECD, 2002). Hoje, na sua 6.ª edição, com numerosas revisões e atualizações, continua a definir a I&D em três grandes categorias: ciência básica, ciência aplicada e desenvolvimento experimental. As definições imputadas a estes três conceitos oferecem terreno comum para as comparações internacionais e para as influentes publicações sobre ciência, tecnologia e inovação da OCDE (Key Science and Technology Statistics and Publications; Main Science and Technology Indicators; Science, Technology and Industry Scoreboard; Science, Technology and Industry Outlook, entre outras). Entretanto, a discussão e produção académica sobre a produção de ciência e tecnologia questiona a abordagem subjacente ao modelo da OCDE e começam a surgir modelos críticos e alternativos (Gibbons et al., 1994; Stokes, 1997).

Uma das principais considerações à utilização dos conceitos de ciência básica, ciência aplicada e desenvolvimento experimental é a evolução linear subjacente ao modelo. A relação entre ciência e tecnologia é apresentada como direcional e o modelo estabelece uma evolução linear da ciência: ciência básica ciência aplicada desenvolvimento experimental produção e difusão.

Este modelo assenta na ideia de que a ciência básica é a produção de novo conhecimento sem considerações da sua aplicação, efeitos práticos ou mesmo de produtos (ideia geralmente atribuída a Vannevar Bush, em 1945), em contraste direto com a ciência aplicada, ligada à aplicação prática, à tecnologia e aos produtos (Godin, 2006). A relação da ciência com a tecnologia é, assim, vista através de um modelo unidimensional e linear, criticado pela sua simplicidade analítica (Stokes, 1997), ou explicada por razões de cariz político para fins de recolha e harmonização estatística (Godin, 2006).

A realidade complexa e de tensão entre a ciência básica e a ciência aplicada leva Stokes a propor uma definição bidimensional, onde considerações da utilidade da ciência figuram como centrais num novo modelo (Stokes, 1997). Godin (2006) faz uma análise histórica e reconhece que o modelo linear da ciência aparece como cristalizado devido à sua simplificação, e que as fontes de financiamento ajudam a fixar as diferentes designações de ciência. A própria OCDE vem reconhecer a conexão entre os diferentes tipos de ciência quando refere: the order in which the three types of R&D activity appear is not meant to suggest that basic research leads to applied research and then to experimental development. There are many flows of information and knowledge in the R&D system (OECD, 2002: 45).

Os conceitos de investigação fundamental e investigação aplicada mantêm-se como conceitos discutíveis, com fronteiras ambíguas e definições algo confusas. A prática reflete a mesma complexidade e variedade. O recente trabalho do Council of Canadian Academies (2012), sobre as práticas de avaliação de desempenho em dez países na área das ciências exatas e engenharias, prefere a designação discovery research, às variantes tradicionais de ciência básica ou ciência pura. Outras formas de referir uma investigação de natureza mais aplicada aparecem como experience or practice-based research (MCTES, 2016) ou investigação em contexto de aplicação (Gibbons et al., 1994).

A definição de investigação aplicada estabelece a capacidade de resolução de um problema prático, quer um melhoramento social ou médico, ou uma vantagem económico-financeira, ou uma recompensa política ou cultural (Roll-Hansen, 2009). Nestes casos, o efeito social da ciência aplicada é subordinado ao cliente, ao industrial, ao financiador, ao político; corresponde a um instrumento ao serviço do cliente, do utilizador ou do financiador. A investigação orientada para objetivos práticos levou ao desenvolvimento de estudos de impacto e ao aumento de uma lógica economicista de value for money (Martin, 2011). Um conjunto de indicadores de impacto predominantemente de natureza económica tornou-se preponderante (spin-offs, patentes, etc.), embora nem sempre os impactos a longo prazo sejam facilmente mensuráveis ou avaliados. Apesar das dificuldades em definir e medir o que é impacto, há necessidade de apreender mais do que os impactos económicos impactos sociais, culturais, políticos e simbólicos da investigação são igualmente parte da agenda de avaliação (Molas-Gollart et al., 2002; Patrício, 2009). Privilegiar alguns indicadores de desempenho sobre outros pode levar à modificação dos comportamentos dos investigadores de forma a valorizar uns resultados sobre outros. Apesar das dificuldades e limitações do conceito de investigação aplicada, mantivemos a sua designação e tentámos clarificar as ambiguidades ao longo do trabalho.

Sobre a avaliação de desempenho das instituições de ensino superior politécnico: entre indicadores quantitativos e qualitativos

As avaliações de desempenho no ensino superior têm vindo a generalizar-se ao nível institucional, departamental e individual, com crescente recurso a indicadores quantitativos como forma de proporcionar e sustentar processos avaliativos. A multiplicação de avaliações académicas tem levado à vulgarização de indicadores quantitativos, referida como uma febre de avaliação (Gingras, 2014). Muitas vezes, trata-se de formas simplificadas de reunir, comparar e hierarquizar indicadores, fazendo tábua rasa da história, missão e contexto da instituição, das formas de trabalho e produção das diferentes áreas científicas, e dos percursos individuais dos investigadores e professores.

Nos processos de avaliação do desempenho académico, as contagens de publicações académicas e os estudos bibliométricos resultantes assumem um papel central (Wilsdon et al., 2015; Gingras, 2014). As diferentes bases de dados (Web of Science, Scopus) e as novas funcionalidades de plataformas online (Medeley, Google Scholar) ganham cada vez mais importância e levam ao desenvolvimento e aprofundamento de técnicas bibliométricas sofisticadas (contagem de citações, autocitações, h-index, fator de impacto, etc.). Surgem novas e alternativas formas para a medição de publicações (Altmetrics). O sistema bibliométrico tem levado a que as medições assumam cada vez maior relevância na avaliação. Todavia, apesar das contribuições métricas para o estudo da avaliação académica, surgem vários alertas para o uso e o abuso de formas cada vez mais complexas de utilização bibliométrica como forma de avaliação de desempenho (Ball e Wilkinson, 1994; Cronin e Sugimoto, 2014; Gingras, 2014).

Várias agências financiadoras na Europa e na América do Norte têm desenvolvido estudos e publicado relatórios procurando encontrar um equilíbrio entre formas de avaliação quantitativas e qualitativas. Partem do pressuposto de que as práticas de avaliação deverão ser compatíveis com as políticas de financiamento da ciência e do ensino superior. A European Science Foundation chegou a produzir um guia de boas práticas, convencida que podia influenciar a qualidade e a integridade do processo de avaliação europeu (European Science Foundation, 2011).

A procura de indicadores de desempenho das IESP no que se refere a atividades de investigação aplicada e de criação cultural tem sido objeto de estudo de várias comissões e grupos de trabalho. Alguns dos estudos internacionais que mais influenciaram a construção do modelo aqui proposto exprimem a tensão entre a necessidade de encontrar indicadores claros e simples e o reconhecimento de que a investigação e a inovação são processos complexos e fortemente dependentes do contexto em que estão inseridos.[3]

Em muitos trabalhos consultados é referida a importância de conciliar indicadores quantitativos com avaliações qualitativas pelos pares (scientific experts ou peer reviewers). Nalguns casos, como nas Universities of Applied Sciences na Holanda, a procura de indicadores de medição da investigação aplicada valoriza a autoavaliação interna onde a missão e o perfil da unidade, a estratégia de I&D, os recursos humanos associados e a qualidade dos investigadores são levados em linha de conta. A experiência do Conselho de Avaliação de Ensino Superior da Finlândia (FINHEEC), bem como a dos Institutos de Tecnologia (IOT) da Irlanda, reconhecem a importância da formação profissional e técnica para o desenvolvimento económico, tecnológico, científico, comercial, industrial, social e cultural, com especial relevância no contexto regional.

Um exemplo recente, apresentado de forma interativa, de como os indicadores quantitativos podem servir fins informativos e comparativos, é o recente trabalho desenvolvido pela equipa do U-Multirank.[4] A metodologia subjacente ao U-Multirank procura fornecer a informação sobre a instituição do ensino superior através de perfis institucionais úteis a cada utilizador. A base permite escolher dimensões a nível de investigação, transferência tecnológica, ensino, orientação internacional e envolvimento regional em conformidade com as características procuradas. Subsequentemente, os perfis variam a nível institucional e as comparações sobre as instituições do ensino superior favorecem um melhor conhecimento público acerca das áreas de competência das mesmas instituições junto de potenciais stakeholders. O U-Multirank exemplifica a possibilidade de se utilizar indicadores quantitativos como fonte de informação e comparação em várias dimensões a nível internacional.

O U-Multirank apresenta um trabalho sistemático de apresentação de indicadores, mas também levanta interrogações e ambiguidades, entre as quais a dificuldade associada ao conceito de investigação aplicada e à sua definição, encontrando-se neste momento na fase piloto de um estudo mais alargado sobre a construção de indicadores sobre investigação aplicada.

A diferença entre áreas e disciplinas científicas também deverá ser equacionada no estudo dos indicadores de desempenho, uma vez que as diferenças são marcadas. A arrumação das áreas científicas frequentemente coloca as ciências sociais e as humanidades de um lado, e as ciências exatas e naturais de outro lado. Existem diferenças entre áreas científicas que vão desde a forma de produção à disseminação científica. As humanidades produzem mais livros. As ciências sociais distinguem-se entre disciplinas a economia e a psicologia publicam mais artigos científicos; já a antropologia e a sociologia distribuem as publicações por livros, capítulos em livros e artigos científicos. Nas engenharias sobressaem proceedings; e as ciências da saúde e as ciências naturais publicam artigos científicos. As publicações científicas dos artigos aparecem nas bases de dados como a Web of Science, Scopus ou Google Scholar. Mais recentemente, a Thomson Reuters criou o Book Citation Index, para medir as publicações em livro (salienta-se a dominância das publicações em inglês). Existe ainda a produção nas Artes, que produzem artefactos, exposições, decoração, design e outros produtos de difícil mensuração.

O uso de uma diversidade de indicadores está enraizado no conhecimento sociológico, para o qual um conjunto de indicadores de natureza diferenciada é desejável na análise do fenómeno. Reduzir o estudo do desempenho académico a um pequeno conjunto de indicadores acaba por ser impeditivo de obter uma visão alargada dos contributos de diferentes áreas científicas, bem como das diferenças que existem nas capacidades e missões de diferentes instituições. Existe uma grande preocupação em que os indicadores sejam utilizados de forma adequada; o perigo é não reconhecer as diversas contribuições dos investigadores de áreas científicas diferentes para a missão institucional ou para o bem público mais amplo. Outra apreensão neste processo reside no facto de os indicadores estarem concentrados no que é mensurável. No entanto, alguns indicadores devem ser considerados relevantes mesmo quando não podem ser rastreados através de fontes quantitativas. É o caso, por exemplo, do desenvolvimento e manutenção de parcerias com responsáveis políticos e com a indústria, ou do trabalho de divulgação do conhecimento para públicos específicos, entre outros.

A avaliação por pares, apesar das suas limitações, continua a ter um apoio generalizado da comunidade científica. Atualmente, não parece razoável concentrar a avaliação de desempenho apenas em indicadores quantitativos, reconhecendo-se a necessidade de integrar indicadores em formas avaliativas mais qualitativas. Os estudos de caso, de natureza mais qualitativa, permitem recolher outro tipo de informação que serve para elucidar alguns dos indicadores quantitativos. É, portanto, fundamental conciliar uma análise quantitativa com processos qualitativos de avaliação de desempenho. Isso fará com que seja possível contextualizar as diferentes escalas de outputs e impactos em que a investigação aplicada se traduz.

Em termos de procedimentos é importante ter uma variedade de indicadores que possam ser implementados de forma flexível. Assim, o quadro de indicadores apresentado estabelece um caminho, que pode ser adaptado, tendo em conta questões de capacidade institucional, mas também de área científica.

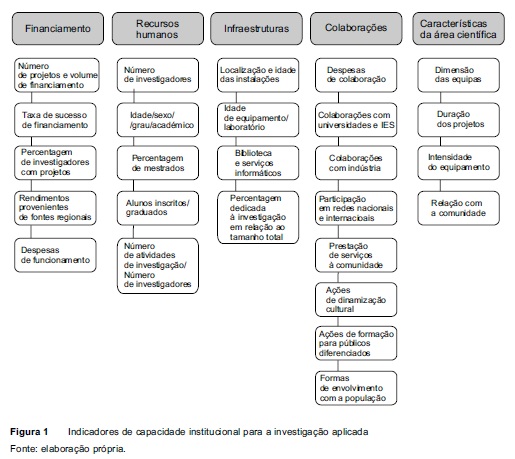

Estratégia metodológica: o modelo input-output-impacto da produção científica

A localização e os contextos económicos e sociais da região moldam o caráter e o tipo de atividades em que as instituições de ensino superior estão envolvidas (Shattock, 2009). A adoção dessa abordagem implica também a ideia de que o perfil da instituição é um fator relevante (Johnes e Yu, 2008; Kao e Hung, 2008) e que o capital humano (académicos, investigadores, estudantes e pessoal administrativo) representa um fator que as instituições utilizam para atingir esta missão (Feng et al., 2011). Na transferência do conhecimento salienta-se a importância dos diplomados que desenvolvem atividades profissionais, estabelecem negócios e empresas, promovem iniciativas nos mais variados campos de atividades de forma a criar riqueza e contribuir para o desenvolvimento. A figura 1 aponta alguns dos principais indicadores de capacidade das instituições de ensino superior, compreendendo cinco grandes áreas: financiamento, recursos humanos, infraestruturas, colaborações e características inerentes a cada área científica. Conforme se adiantará, cada uma destas áreas contribui enquanto input para o modelo proposto modelo de inputs-outputs-impactos (figura 2). Importa lembrar que tanto a investigação aplicada, como a formação qualificada que ministram, se afiguram como componentes centrais no âmbito da respetiva missão institucional das IESP.

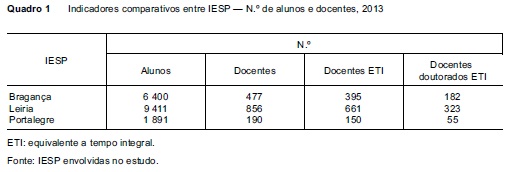

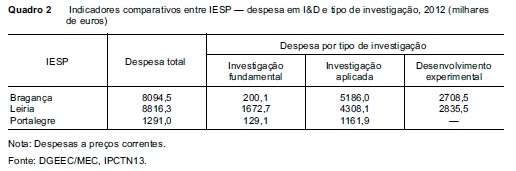

Os resultados apurados foram baseados na seleção de três IESP, nomeadamente de Bragança (IPB), de Leiria (IPL) e de Portalegre (IPP), e na escolha e análise de 12 casos de estudo, de projetos de investigação aplicada. Como foi referido atrás, a escolha das IESP levou em conta a dimensão e a inserção regional. Os quadros 1 e 2 reúnem alguns indicadores específicos das IESP consideradas, contribuindo para o desenho deste perfil.

Da leitura desses quadros ressaltam algumas diferenças em termos do posicionamento das três IESP, resultado de diferentes variáveis, entre as quais a localização geográfica e a dinâmica do tecido económico-social em que as mesmas instituições operam, a sua dimensão no que respeita ao volume de recursos humanos qualificados e, por conseguinte, a capacidade de investigação instalada.

Na relação com estas IESP pretendia-se conhecer em profundidade alguns projetos de investigação, a partir dos depoimentos dos investigadores coordenadores e de beneficiários/ utilizadores/ parceiros afetos a cada projeto. Considerou-se esta uma forma pertinente para testar e validar indicadores de desempenho, em sintonia com os modelos de equipas internacionais.

A metodologia foi composta por quatro fases, cada uma das quais incidindo sobre atores específicos. Assim, a primeira fase privilegiou o contacto com aquelas IESP e os seus gabinetes de apoio à investigação; a segunda fase centrou-se no contributo dos investigadores coordenadores de projetos de investigação aplicada; quanto à terceira fase, procurou-se captar a perspetiva dos beneficiários/ utilizadores/ parceiros envolvidos; e na quarta fase, apresentaram-se os resultados alcançados a peritos nacionais e internacionais. A preceder estes quatro momentos, acresce uma fase de exploração e análise de dados, quer de natureza estatística, quer de natureza mais documental, esta última a partir da informação disponibilizada pelas estruturas de gestão da I&D das IESP envolvidas no estudo.

Para a concretização da primeira fase, solicitou-se às três IESP a seleção de quatro projetos de investigação aplicada, considerando:

i. a sua relevância a nível local e regional, ou ainda a nível nacional e internacional;

ii. a captação de um leque tão alargado quanto possível de informação sobre os projetos de investigação aplicada;

iii. a cobertura dos diferentes domínios científicos (Ciências da Vida e da Saúde; Ciências Exatas e da Engenharia; Ciências Naturais e do Ambiente; e Ciências Sociais e Humanidades),[5] de forma a compreender as diferenças e as especificidades da investigação aplicada em cada um deles; e

iv. a data de conclusão, nomeadamente nos últimos dois anos, de forma a facilitar a captação, tanto dos outputs do projeto, como dos impactos na comunidade ou na sociedade em geral.

Após a seleção dos projetos, por parte das IESP, entrevistaram-se os investigadores coordenadores dos mesmos e solicitou-se a resposta a um breve questionário segunda fase. Ambos os inquéritos procuraram compreender em que medida os indicadores de desempenho apresentados eram eficazes na avaliação do projeto em apreço. As entrevistas, semiestruturadas, permitiram aprofundar o entendimento dos investigadores coordenadores sobre aspetos particulares da avaliação nos seus domínios e áreas científicas, em complemento com a informação quantitativa recolhida pelo questionário.

Na terceira fase pretendeu-se entender a perspetiva dos beneficiários/ utilizadores/ parceiros envolvidos, através de entrevistas também semiestruturadas. Esta fase da investigação foi relevante na medida em que evidenciou, em vários casos, o contributo dos projetos de investigação das IESP para a vida da comunidade e da região, tão pouco considerado em avaliações de tipo mais quantitativo.

Por fim, a quarta fase compreendeu a apresentação dos resultados alcançados a um painel de peritos nacionais e internacionais. Por esta via, procurou-se: (i) expor os principais resultados da pesquisa, (ii) obter retorno relativamente aos mesmos e (iii) testar, de alguma forma, a robustez de um modelo de inputs-outputs-impactos na avaliação do desempenho das IESP.

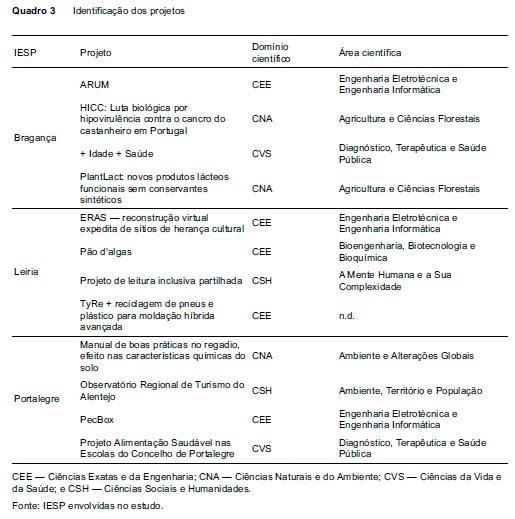

Os projetos de investigação selecionados e relativos a cada IESP, bem como o seu domínio e área científica, encontram-se sistematizados no quadro 3.

Com recurso ao modelo de inputs-outputs-impactos, usado para a avaliação dos indicadores de desempenho das atividades de investigação aplicada e criação cultural das IESP, foi também possível alcançar resultados com interesse para cada uma das áreas científicas. Optou-se por este modelo por se considerar que atribui maior ênfase aos resultados resultados de natureza mais académica (outputs) e resultados mais societais (impactos em geral). Seria possível desdobrar este modelo em quatro partes, inputs-outputs-outcomes-impactos ou desagregar atividades ou colaborações inerentes ao processo de investigação. As atividades associadas aos processos, de natureza mais processual e relacional, foram levadas em conta e, tanto quanto possível, absorvidas nos indicadores de output e impacto (por exemplo, as participações em redes).

A opção recaiu num modelo mais compacto, pois considerou-se um processo melhor servido pela combinação de avaliações qualitativas complementadas com indicadores quantitativos. A figura 2 ilustra o exposto atrás.

Os indicadores não devem ser aplicados de forma rígida, mas antes com flexibilidade, tendo em conta as diferenças das áreas científicas, as dificuldades em medir impactos e o tempo necessário para avaliar resultados, considerando metas de curto, médio ou longo prazo.

Reflexões sobre os indicadores de output e de impacto

Tendo em conta a utilização do modelo atrás identificado foi possível observar que os 12 projetos de investigação aplicada, estudados como casos de sucesso, apresentam algumas diferenças. Os projetos variaram por área científica, por montante e fonte de financiamento, e por período de duração. Apesar da sua variabilidade, todos apresentaram fortes ligações a parceiros institucionais (públicos e privados; locais, regionais, nacionais ou internacionais), em muitos casos diretamente envolvidos nos projetos. A existência de colaborações com variadíssimas entidades (sociais, empresariais, comunitárias, poder local) demonstra a importância das redes e das ligações ao tecido social e económico envolvente para a avaliação do desempenho das IESP nacionais.

Outputs académicos

Os resultados mais valorizados, de forma ampla, correspondem às publicações científicas em artigos, livros, capítulos de livros e comunicações científicas. Através dos questionários verificou-se que, em todas as áreas científicas, é reconhecida a importância das publicações científicas e académicas. Todavia, nas entrevistas realizadas aos investigadores dos projetos ficou clara a importância também atribuída a outras formas de publicação para além das academicamente reconhecidas, nomeadamente relatórios, boletins, prospetos, notas informativas, folhetos e brochuras.

Vários projetos desenvolveram atividades relevantes na preparação e divulgação de informações científicas, técnicas e generalistas sobre o projeto e os seus resultados. Este tipo de publicação aparece como valorizada na investigação aplicada, pois transmite informação ao público interessado sobre as características e as formas de uso do produto, do processo ou do serviço.

De acordo com alguns responsáveis de IESP, a valorização dos outputs académicos pode ser perversa, ao colocar um enfoque excessivo na carreira dos investigadores e ao individualizar demasiado a produção de conhecimento, a qual progressivamente se desliga de outros objetivos, como os ligados ao desenvolvimento da região e da instituição.

Impactos

Definir e medir impactos é uma tarefa difícil e complexa. A introdução de indicadores de impacto acaba por privilegiar um número elevado de indicadores, complexificando ainda mais o processo. Os impactos variam em termos das perceções dos próprios investigadores, na sua dimensão e valor, nos efeitos positivos, desejáveis, imprevistos, diretos e indiretos, imediatos, a curto, médio ou longo-prazo.

Os argumentos desfavoráveis à introdução de indicadores de impacto assinalam as dificuldades em definir claramente o impacto, os custos inerentes à introdução de mais indicadores e os efeitos comportamentais de maximizar impactos sem os desejados benefícios (Martin, 2011). Martin explica o aumento de spin-offs universitárias em Inglaterra como reação à introdução do indicador de transferência tecnológica [ ] actors adjusted their behaviour in order to maximize their score (id. ibid.: 250). Apesar das dificuldades de medição de impactos, cada vez mais agências financiadoras de ciência procuram introduzir impactos nos processos de avaliação (HEFCE no Reino Unido, Research Quality Framework na Austrália).

Os impactos económicos, sociais, organizacionais, políticos, culturais e simbólicos e/ou de reconhecimento procuram apreender a variabilidade das concretizações da investigação aplicada. Trata-se de encontrar formas de medir o contributo da investigação para a sociedade. Os impactos enquadram-se nesta relação ciência-sociedade e visam captar e identificar novos ou melhores produtos, processos ou serviços, ganhos de eficiência, aumentos de comercialização, reconhecimentos mediáticos e sociais, envolvimento comunitário, alterações de práticas e produtos culturais, alterações comportamentais, entre outros benefícios. O conjunto é amplo e o grau de concretização das realizações, sem reduzir tudo a um valor monetário, difícil.

A ideia de um processo unidirecional e linear de investigação aplicada, incluindo os impactos sobre a comunidade, organização ou política, não se encaixa na descrição dos projetos analisados. A análise das entrevistas permitiu compreender o impacto como um processo e não apenas como um resultado. Permitiu, ainda, compreender que o impacto destes projetos pode certamente ser mensurável por exemplo, número de alunos empregados ou número de downloads feitos de um livro mas tão importante quanto esse tipo de impacto é o impacto menos tangível por exemplo, as mudanças de prática dos agricultores relativamente ao uso do solo e regadio. Importante é, também, considerar que a investigação aplicada, ao envolver parceiros externos, origina, muitas vezes, relacionamentos duradouros e uma ampliação da rede de colaborações, aspetos ativamente implicados no desenvolvimento das regiões.

Os indicadores económicos mais valorizados pelos responsáveis dos IESP e pelos investigadores coordenadores inquiridos dizem respeito a formas económico-financeiras de medir os resultados: receitas, investimento e financiamento; poupar nos custos e criar empresas e empregos. Não obstante, aqueles responsáveis referem existir, muitas vezes, uma diferente valorização de objetivos por parte da instituição e por parte dos investigadores, marcando os impactos obtidos. Os impactos económicos geralmente reconhecidos como importantes tiveram um resultado surpreendente no âmbito da investigação realizada, dado que nem todos os indicadores de impacto económico registaram a mesma ordem de importância. Por exemplo, os indicadores número de postos de trabalho criados e número de empresas criadas registaram muito baixos níveis de importância.

Já no que respeita aos impactos sociais, incorporam aspetos relacionados com a mudança ou a alteração das condições sociais e/ou de práticas e hábitos sociais. Incluem também a capacidade de satisfazer o cliente ou o utilizador. Estes indicadores detêm uma mensuração mais trabalhosa do que os de cariz económico. As entrevistas com os investigadores e com os utilizadores permitem evidenciar algumas formas de medição possíveis. Alguns destes indicadores poderão implicar a introdução de formas adicionais de recolha de informação por exemplo, o desenvolvimento de uma escala de impactos sociais ou mesmo entrevistas com os interessados, neste caso os beneficiários/utilizadores. No entanto, outros indicadores são mais facilmente mensuráveis, como por exemplo o envolvimento dos estudantes com empresas e outras entidades.

Os impactos sociais são mais valorizados pelos investigadores das áreas das ciências sociais e humanidades e das ciências da vida e da saúde do que nas áreas das engenharias e ciências exatas, e ciências naturais e ambientais. Mas, no geral, os discursos dos investigadores reconhecem a importância deste tipo de impactos.

Os impactos políticos aprofundam alguns impactos sociais em termos de alterações e mudanças ao nível das atividades de caráter político e das questões públicas. A cidadania ativa e consciente procura aumentar o interesse e a participação em questões públicas poder local, atividades ambientais, apoiar programas, desenvolver iniciativas de caráter social. Em particular, a investigação em áreas das ciências sociais e humanidades desenvolve este tipo de preocupação e são esses projetos que manifestam mais impactos políticos. As mesmas dificuldades quantitativas operam sobre os indicadores políticos.

Por fim, os impactos culturais, e a criação cultural, ressaltam nos projetos das áreas das ciências sociais e humanidades, mas também é possível indiciar impactos nas ciências da vida e da saúde. Em relação ao impacto simbólico ou ao reconhecimento apresenta-se como mais mensurável, uma vez que se pode quantificar o número de convites, número de prémios e outras formas de angariação. O reconhecimento através de prémios foi um aspeto muito observável e referido pelos investigadores de todas as áreas científicas.

Conclusões

Através da combinação de metodologias intensivas e extensivas, foi possível observar a diversidade dos projetos e a importância da investigação aplicada para as regiões em que cada IESP se insere. Esta estratégia metodológica permitiu igualmente testar e validar os vários indicadores considerados, contribuindo assim para a avaliação do desempenho das IESP, mais concretamente no que respeita à qualidade da sua investigação aplicada.

Paralelamente, do estudo realizado sobressai ainda uma possível estratégia para a definição e implementação de um modelo de avaliação mais consentâneo com as especificidades do sistema de ensino superior politécnico. As vertentes operacionais dessa estratégia incluem:

i. a harmonização da recolha e análise de dados e resultados de investigação científica;

ii. oportunidades de financiamento específicas para promover investigação aplicada;

iii. estimular as IESP a divulgar histórias ou casos de sucesso de investigação aplicada; e

iv. apoiar gabinetes regionais que promovam a transferência de conhecimento e tecnologia.

No que respeita à primeira vertente, de harmonização do processo de recolha e análise de dados e resultados de investigação, trata-se de simplificar e evitar a duplicação do preenchimento de diferentes bases de dados e de sistemas de informação. Sem dúvida que a existência de indicadores de desempenho e/ou relatórios de progresso são ferramentas essenciais para aferir as atividades de investigação e análise de resultados, tal como para apoiar as políticas de investigação e de avaliação sobre o sistema científico e de inovação nacional. No entanto, a falta de um planeamento coordenado, ao nível dos sistemas de informação e de desenvolvimento, levanta dificuldades na obtenção de dados atualizados. Dificulta, por outro lado, ter informação coerente das atividades de investigação desenvolvidas e em curso e dos seus resultados, fundamental para a tomada de decisão individual (investigadores), a nível da unidade (unidades de investigação), institucional (IES) e nacional (decisores políticos de investigação e agências de gestão da investigação).

Existem, no entanto, exemplos que se podem constituir como eventuais boas práticas e com potencial de replicação, por exemplo, o caso do Centro de Investigação em Informática e Comunicações (CIIC), do Instituto Politécnico de Leiria, que aborda questões centrais para a recolha e análise de resultados da investigação nacional, tanto do ponto de vista da gestão da investigação, como dos sistemas de informação.

No que se refere à segunda vertente, relativa às oportunidades de financiamento específicas para promover investigação aplicada, a definição destes modelos de indicadores levou a reconhecer a existência de limitações em relação ao contexto de investigação das IESP. Um dos efeitos latentes do sistema binário tem sido o de conduzir os investigadores das IESP a realizar atividades de investigação em instituições de ensino superior universitário (IESU) próximas. Enquanto a colaboração institucional é uma prática bem-vinda, esta colaboração ocorre em detrimento do desenvolvimento das capacidades de investigação das próprias IESP.[6]

Para ter em conta a tendência de perda da capacidade de investigação por parte das IESP e contribuir para manter e incentivar as suas iniciativas de investigação, são necessárias medidas para promover a investigação aplicada nestes institutos. A promoção da investigação aplicada ajudaria na consolidação de centros de investigação nas IESP, em reter investigadores e promover o desenvolvimento e inovação regional. Há iniciativas diferenciadas de financiamento em instituições de tipo politécnico que merecem análise:

a) A Canadian Foundation for Innovation (CFI), infraestrutura de financiamento no Canadá para a investigação em colleges e CEGEPs desde 1997. O seu lema to think big promoveu uma forte colaboração entre os setores académico, público, privado e sem fins lucrativos para desenvolver investigação e inovação.[7]

b) A Netherlands Organisation for Applied Scientific Research (TNO) que, desde 1932, financia a investigação na Holanda e contribui para a competitividade das empresas e organizações, para a economia e para a qualidade de vida em geral. O seu objetivo é aumentar a participação das universidades de ciências aplicadas e promover as suas atividades de investigação.[8]

Relativamente à terceira vertente estimular as IESP a divulgar casos de sucesso de investigação aplicada os projetos bem-sucedidos apresentados constituem histórias poderosas de influência regional, nacional e mesmo internacional da investigação realizada pelas IESP. Neste sentido, as mesmas instituições devem ser encorajadas a divulgar as suas histórias de sucesso numa base regular. Tal formato já é usado pelo Higher Education Funding Council for England (HEFCE), em que um dos parâmetros de avaliação tem por base a análise do impacto a partir de estudos de caso. Em 2014, o Research Excellence Framework (REF) convidou as universidades a apresentarem exemplos do impacto da sua investigação em termos da sua natureza, escala e beneficiários. As histórias de sucesso são parte de um processo que demonstra os benefícios amplos e variados da investigação para a sociedade.

Por fim, no que concerne à última vertente, relativa ao apoio a prestar aos gabinetes regionais que promovam a transferência de conhecimento e tecnologia, os estudos sobre investigação aplicada nas universidades de ciências aplicadas mostram o seu contributo para o desenvolvimento e inovação regional. No caso do estudo por nós realizado, observa-se que os investigadores expressaram uma valorização limitada dos indicadores de impacto económico da sua investigação. Em parte, pode ser resultado de relações institucionais fracas com institutos de interface, como gabinetes de transferência de tecnologia; ou, por outro lado, pode ser devido ao financiamento fragmentado que não garante follow-ups. Tal também pode ser resultado de abordagens ad hoc ou fragmentadas para abordar os impactos económicos da investigação.

As IESP poderiam beneficiar de laços mais estreitos com instituições de interface, de forma a valorizar os impactos económicos dos seus projetos. Os investigadores devem ter fácil acesso a informação, aconselhamento e conhecimentos específicos de gabinetes de transferência de conhecimento e tecnologia. Estes precisam de ser facilmente acessíveis e sintonizados com a missão dos mesmos institutos. Uma possível orientação poderia ser a de avaliar a experiência recente com as Oficinas de Transferência de Tecnologia, Inovação e Conhecimento (OTIC). Por esta via poderia garantir-se que as futuras atividades reforçassem e consolidassem atividades anteriores, promovendo a valorização económica da investigação aplicada.[9]

Como objetivos orientadores desta prática, teríamos a possibilidade de construir, fortalecer e valorizar os gabinetes de conhecimento e transferência de tecnologia; de apoiar diferentes formas de envolvimento académico e promover impactos sociais, económicos, culturais, políticos e simbólicos; de contribuir para a produção e melhoria de novos produtos, processos e serviços e a sua comercialização; e de melhorar a qualidade de vida dos cidadãos. Esta capacitação teria na base um processo de cooperação, em rede, entre diferentes universidades e institutos politécnicos, públicos e privados, e organizações sem fins lucrativos.

Todavia, apesar do quadro aqui traçado, procurando enfatizar a relevância resultante da complementaridade entre indicadores de índole quantitativa e qualitativa, tendo em conta a especificidade das IESP, impõe-se deixar em aberto algumas interrogações enquanto pontos de partida para futuras pesquisas e reflexões. Desde logo, a necessidade de aferir as limitações decorrentes da utilização de indicadores clássicos no contexto das IESP e como adaptá-las à sua realidade. Por outro lado, apesar de se ter procurado com este estudo contribuir para a relevância de um sistema que tome em consideração os impactos de natureza social, cultural, económica, política e simbólica, decorrentes da investigação aplicada, está por fazer um exercício mais aprofundado visando aferir os mecanismos mais ajustados à medição deste tipo particular de indicadores.

Referências bibliográficas

Almeida, Luciano de (2008), Evolução do Sistema de Ensino Superior após a Revolução de Abril de 1974. Expansão e Desregulação. Reforma no Quadro do Espaço Europeu do Ensino Superior, Cáceres, Universidad de Extremadura, tese de doutoramento em Educação. [ Links ]

Ball, Robert, e Rob Wilkinson (1994), The use and abuse of performance indicators in UK higher education, Higher Education, 27, pp. 417-427. [ Links ]

Bush, Vannevar (1945), Science. The Endless Frontier, Washington, DC, US Government Printing Office. [ Links ]

Cave, M., S. Hanney, M. Henkel, e M. Kogan (2006 [1996]), The Use of Performance Indicators in Higher Education. The Challenge of the Quality Movement, Londres, Jessica Kingsley Publisher. [ Links ]

Comissão de Educação e Ciência da Assembleia da República (2010), A Ciência em Portugal Relatório, Lisboa, Edições da Assembleia da República. [ Links ]

Council of Canadian Academies (2012), Informing Research Choices. Indicators and Judgment, Otava, The Expert Panel on Science Performance and Research Funding, pp. 1-162. [ Links ]

Cronin, Blaise, e Cassidy Sugimoto (orgs.) (2014), Beyond Bibliometrics Harnessing Multidimensional Indicators of Scholarly Impact, Cambridge, MA, The MIT Press. [ Links ]

Dias, Ana (2012), A Atividade Profissional dos Docentes dos Institutos Superiores Politécnicos Portugueses. Envolvimento em Atividades de Investigação e Transferência e Valorização Económica do Conhecimento, Lisboa, ISCTE-IUL, dissertação de mestrado em Sociologia. [ Links ]

European Commission (2009), Outcome and impact level indicators, Education Sector Working Paper, setembro. [ Links ]

European Science Foundation (2011), European Peer Review Guide Integrating Policies and Practices into Coherent Procedure, Estrasburgo, European Science Foundation. [ Links ]

Feng, Hui, Chia-Shen Chen, Chuan-Hung Wang, e Hsueh-Chiao Chiang (2011), The role of intellectual capital and university technology transfer offices in university-based technology transfer, The Service Industries Journal, 32, pp. 899-917. [ Links ]

Gibbons, Michael, Camille Limoges, Helga Novotny, Simon Schwartzman, Peter Scott, e Martin Trow (1994), The New Production of Knowledge. The Dynamics of Science and Research in Contemporary Societies, Londres, Sage Publications. [ Links ]

Gingras, Yves (2014), Les Dérives de lEvaluation de la Recherche. Du Bon Usage de la Bibliométrie, Paris, Raisons dAgir. [ Links ]

Goddard, John, Ulrich Teichler, IIkka Virtanen, Peter West, e Jaana Puukka (2003), Progressing external engagement a re-evaluation of the third role of the University of Turku, Publications of the Finish Higher Education Evaluation Council, 16. [ Links ]

Godin, Benoit, (2006), Research and development: how the D got into R&D, Science and Public Policy, 33 (1) pp. 59-76. [ Links ]

HEFCE Higher Education Funding Council for England (2015), University research has wide and varied benefits, 25 de março, disponível em: http://www.hefce.ac.uk/news/newsarchive/2015/Name,103729,en.html (última consulta em novembro de 2017). [ Links ]

Johnes, Jill, e Li Yu (2008), Measuring the research performance of Chinese higher education institutions using data envelopment analysis, China Economic Review, 19 (4), pp. 679-696. [ Links ]

Kao, Chiang, e Hsi-Tai Hung (2008), Efficiency analysis of university departments: an empirical study, Omega, 36 (4), pp. 653-664. [ Links ]

Liu, Cai Ne, e Ying Cheng (2005), The academic ranking of world universities, Higher Education in Europe, 30 (2), pp. 127-136. [ Links ]

Lockett, A., e M. Wright (2005), Resources, capabilities, risk capital and the creation of university spin-out companies, Research Policy, 34 ( 7), pp. 1043-1057. [ Links ]

Maassen, Peter, Jack Spaapen, Outi Kallionen, Paivi Keranen, Markku Penttinen, Roswitha Wiedenhofer, e Matti Kajaste (2012), Evaluation of Research, Development and Innovation Activities of Finnish Universities of Applied Sciences. A Preliminary Report, Helsínquia, Publications of the Finnish Higher Education Evaluation Council (FINHEEC), pp. 1- 26. [ Links ]

Martin, Ben (2011), The research excellence framework and the impact agenda: are we creating a Frankenstein monster?, Research Evaluation, 20 (3), pp. 247-254. [ Links ]

MCTES Ministério da Ciência, Tecnologia e Ensino Superior (2016), Um Programa de Modernização e Valorização dos Institutos Politécnicos, em Articulação Com Uma Estratégia Para o Desenvolvimento de Cidades e Regiões para o Conhecimento. Princípios de Orientação Para Uma Nova Ação de Política Pública, fevereiro de 2016, pp. 1-6, disponível em: https://cnm.fc.up.pt/~wordpress/wp-content/uploads/2016/03/Programa%20IPs.pdf (última consulta em novembro de 2017).

Molas-Gollart, Jordi, Ammon Salter, Pari Patel, Alister Scott, e Xavier Duran (2002), Measuring Third Stream Activities, Brighton, UK, SPRU, University of Sussex. [ Links ]

OECD (2002), Frascati Manual 2002. Proposed Standard Practice for Surveys on Research and Experimental Development, Paris, OECD Publishing (6.ª edição). [ Links ]

OECD (2007), Higher Education and Regions. Globally Competitive, Locally Engaged, Paris, OECD Publishing. [ Links ]

Patrício, Maria Teresa (2009), The Third Mission of Higher Education Institutions, Governance Collection on University Establishments Document N.º 5, Institute for Governance of Private and Public Organisations, Montreal, março de 2009, pp. 1-48. [ Links ]

Roll-Hansen, Nils (2009), Why the distinction between basic (theoretical) and applied (practical) research is important in the politics of science, LSE Centre for the Philosophy of Natural and Social Sciences Contingency and Dissent in Science Technical Report 04/09, Damien Fennell Editor, pp. 1-30. [ Links ]

Shattock, Michael (2009), Entrepreneurialism and organizational change in higher education, em Michael Shattock (org.), Entrepreneurialism in Universities and the Knowledge Economy, Maidenhead, UK, e Nova Iorque, USA, Society for Research into Higher Education e Open University Press, pp. 1-8. [ Links ]

Stokes, Donald (1997), Pasteurs Quadrant Basic Science and Technological Innovation, Washington, DC, Brookings Institution Press. [ Links ]

Urbano, Cláudia (2011), A (id)entidade do ensino superior politécnico em Portugal: da Lei de Bases do Sistema Educativo à Declaração de Bolonha, Sociologia, Problemas e Práticas, 66, pp. 95-115. [ Links ]

Vorley, Tim, e Jen Nelles (2008), (Re)conceptualising the academy: institutional development of and beyond the third mission, Higher Education Management and Policy, 20 (3), pp. 1-17, disponível em: http://www.oecd-ilibrary.org/education/re-conceptualising-the-academy_hemp-v20-art25-en (última consulta em novembro de 2017). [ Links ]

Weert, Egbert de, e Maarja Soo (orgs.) (2009), Research at Universities of Applied Sciences in Europe. Conditions, Achievements and Perspectives, Twente, Universities of Applied Sciences Network, Center for Higher Education Policy Studies (CHEPS), University of Twente, pp. 1-79. [ Links ]

Whitchurch, Celia (2008), Shifting identities and blurring boundaries: the emergence of third space professionals in the UK Higher Education, Higher Education Quarterly, 62 (4), pp. 377-396. [ Links ]

Wilsdon, J. et al. (2015), The Metric Tide. Report of the Independent Review of the Role of Metrics in Research Assessment and Management, Higher Education Funding Council for England (HEFCE), DOI: 10.13140/RG.2.1.4929.1363 [ Links ]

Receção: 27 de setembro de 2016 Aprovação: 08 de junho de 2017

Notas

[1] Este tema foi objeto de uma comunicação apresentada no IX Congresso Português de Sociologia Território de Territórios, 6 a 8 de julho de 2016.

[2] Projeto do CIES-IUL, em parceria com o Instituto Politécnico de Portalegre, financiado pela FCT.

[3] Ver European Network for Universities of Applied Sciences (Weert e Soo, 2009); Evaluation of Research, Development and Innovation Activities of Finnish Universities of Applied Sciences (Maassen et al., 2012); Council of Canadian Academies (2012).

[4] Cf. http://www.umultirank.org/#!/home?trackType=home&sightMode=undefined§ion=entrance

[5] Adoção dos domínios científicos definidos pela FCT (https://www.fct.pt/apoios/projectos/concursos/2012/docs/Dominios_e_Areas_Cientificas_C2012.pdf).

[6] A recente iniciativa do Ministério da Ciência, Tecnologia e Ensino Superior, traduzida no Programa de Modernização e Valorização dos Institutos Politécnicos, em Articulação com Uma Estratégia para o Desenvolvimento de Cidades e Regiões com Conhecimento , divulgada em fevereiro de 2016, definindo um conjunto de princípios de orientação para uma nova ação política, pretende constituir um contributo para este domínio.

[7] Cf. http://www.innovation.ca/en/AboutUs/News/Cégepsandcollegesthinkbig

[8] Cf. https://www.tno.nl/en/about-tno/more-about-our-work/

[9] Cf. http://portal.ipvc.pt/portal/page/portal/otic/conhecer_otic/rede_otic